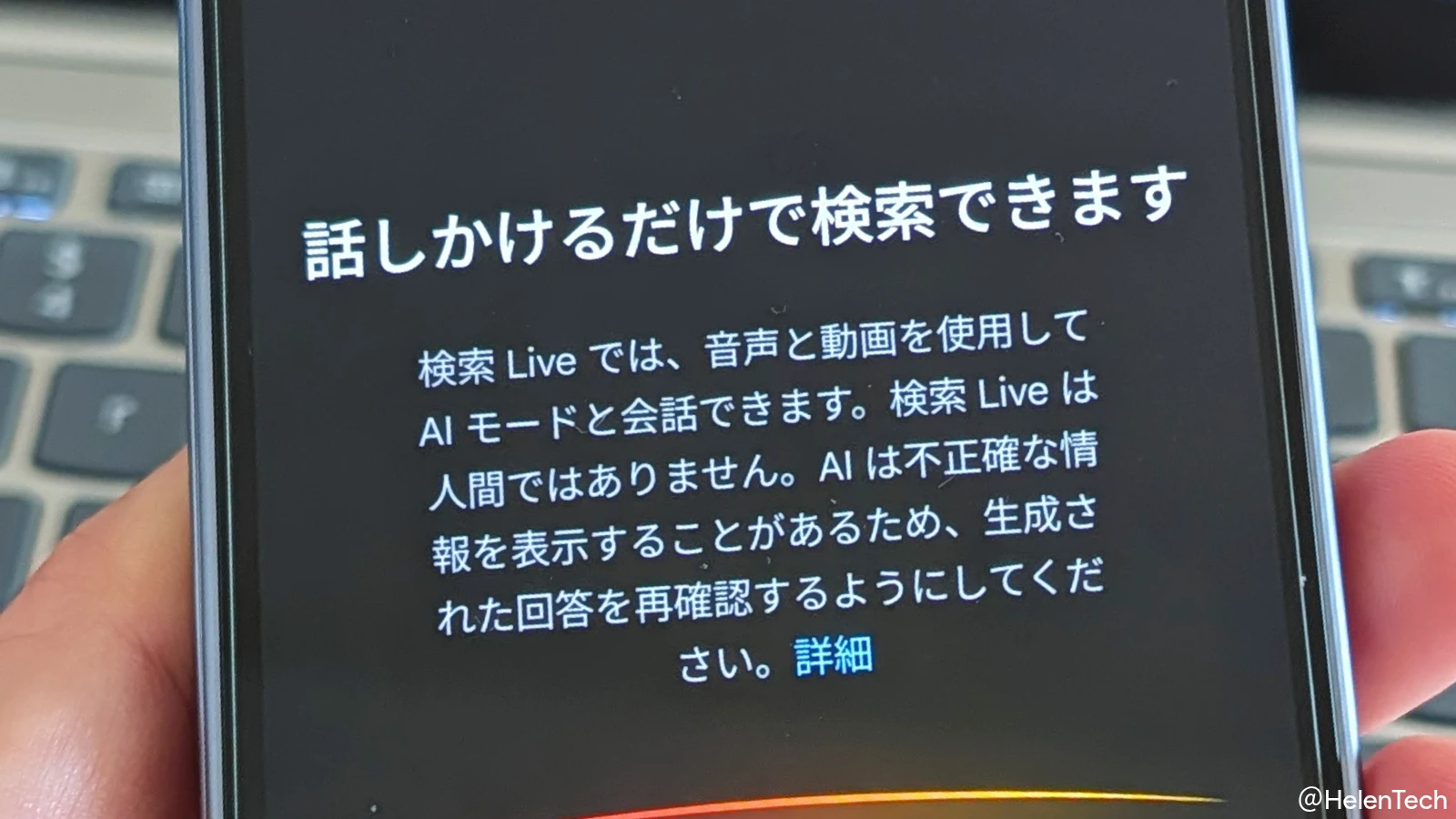

Google は 2026 年 3 月 26 日(現地時間)、Google 検索における対話型機能「検索 Live (Search Live)」のグローバル展開を発表しました。

すでに米国など一部の地域で利用できましたが、現在 AI モードが提供されている 200 以上の国と地域が対象となり、音声やスマートフォンのカメラを用いたリアルタイムな検索対話が利用可能になっています。

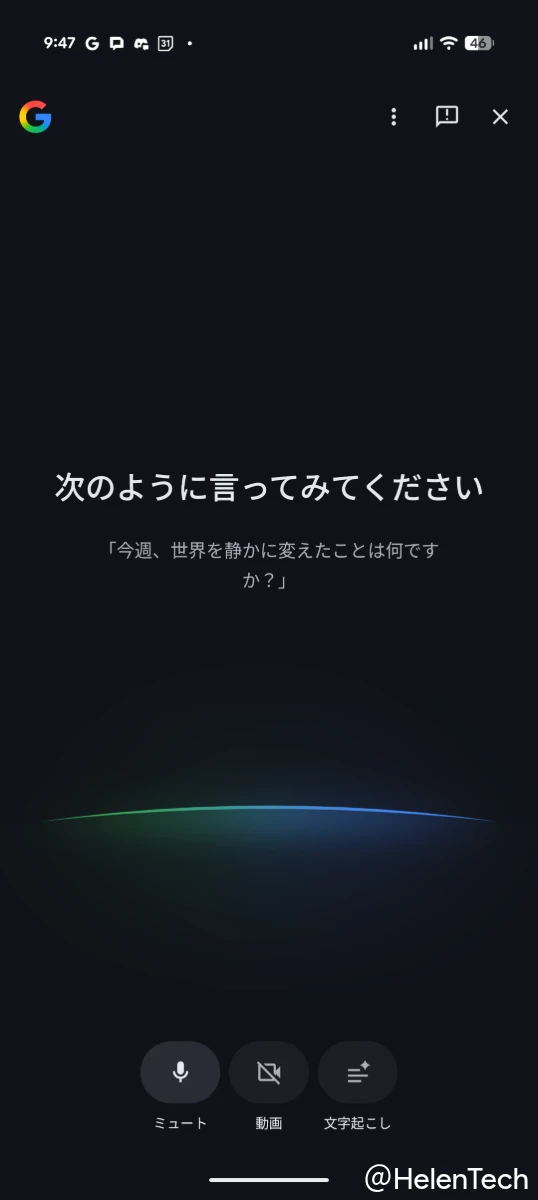

記事執筆時点で、筆者の日本語環境の Google アプリ上で「検索 Live」が利用可能になっていることを確認しました。

最新モデル「Gemini 3.1 Flash Live」による多言語対応

今回の Search Live の大規模な展開を支えているのは、同日に発表された新しい音声 AI モデル「Gemini 3.1 Flash Live」です。このモデルは多言語処理に優れており、世界中のユーザーがそれぞれの母語で自然な会話を行えるように設計されています。

先ほどの記事でもお伝えしたとおり、Gemini 3.1 Flash Live は直感的で自然な会話処理を得意としています。これにより、検索結果をただ音声で読み上げるだけでなく、ユーザーの疑問に対してより人間らしいスムーズなやり取りで応答してくれるようになっています。

Search Live の使い方と活用シーン

Search Live は、文字入力での検索では解決が難しい場面や、リアルタイムなサポートが必要な状況での利用が想定されています。

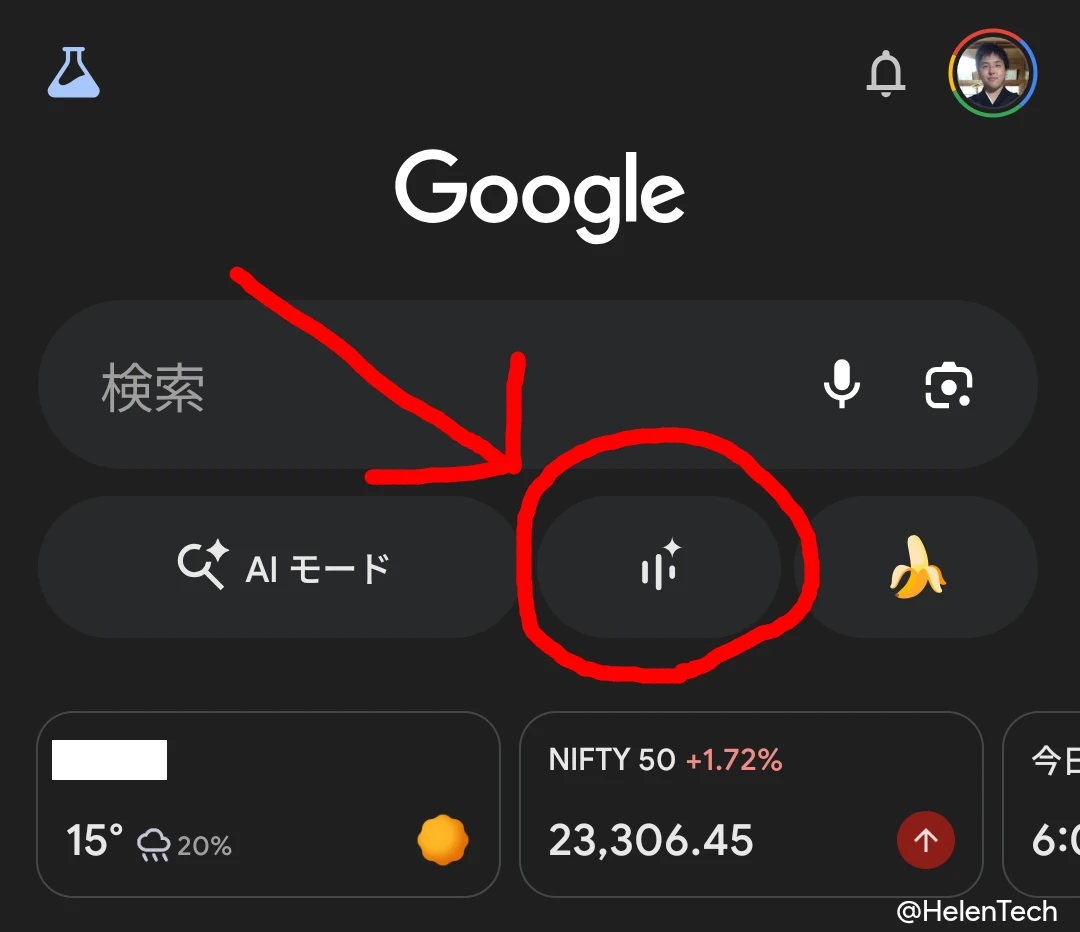

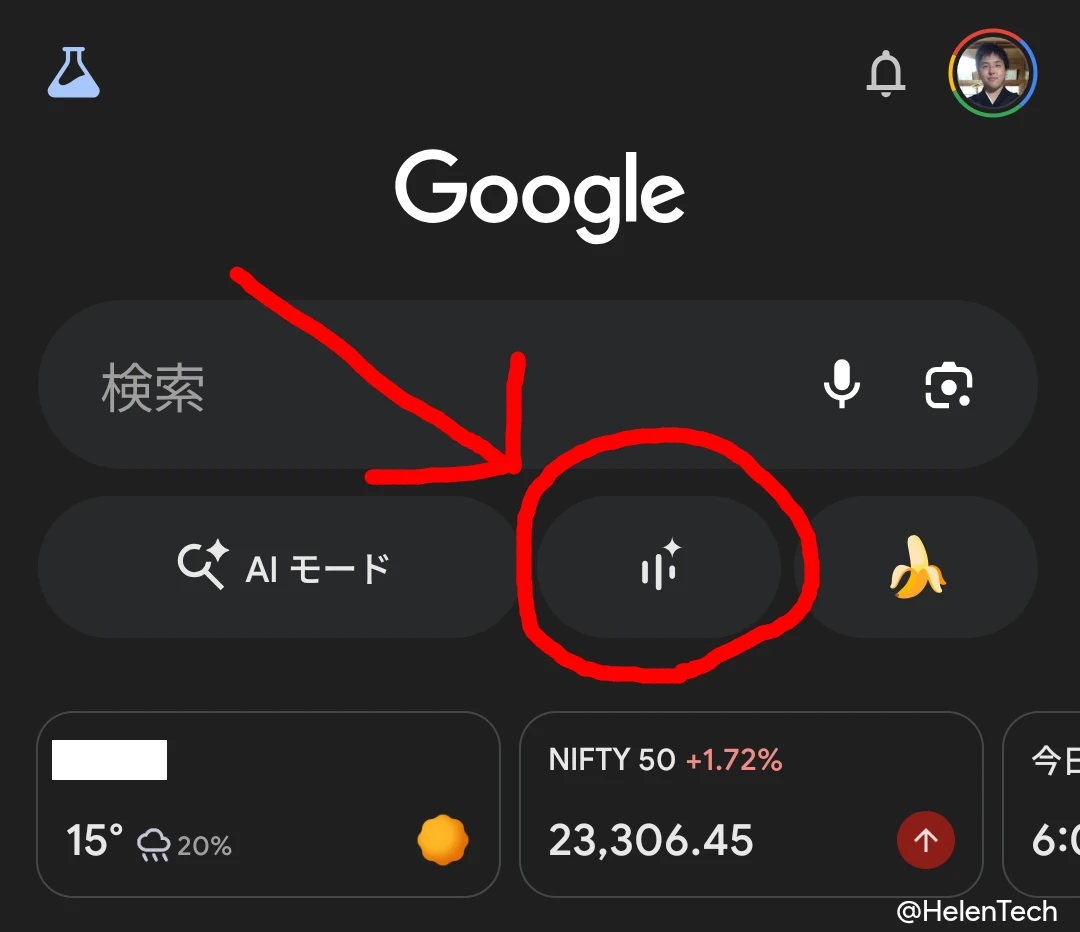

使い方は、Android または iOS の Google アプリを開き、検索バーの下にある「Live」アイコンをタップするだけで起動します。

そのまま声に出して質問すれば、音声による有益な回答が返ってくるほか、ウェブサイトのリンクなどを通じてさらに深く情報を掘り下げていくことができます。

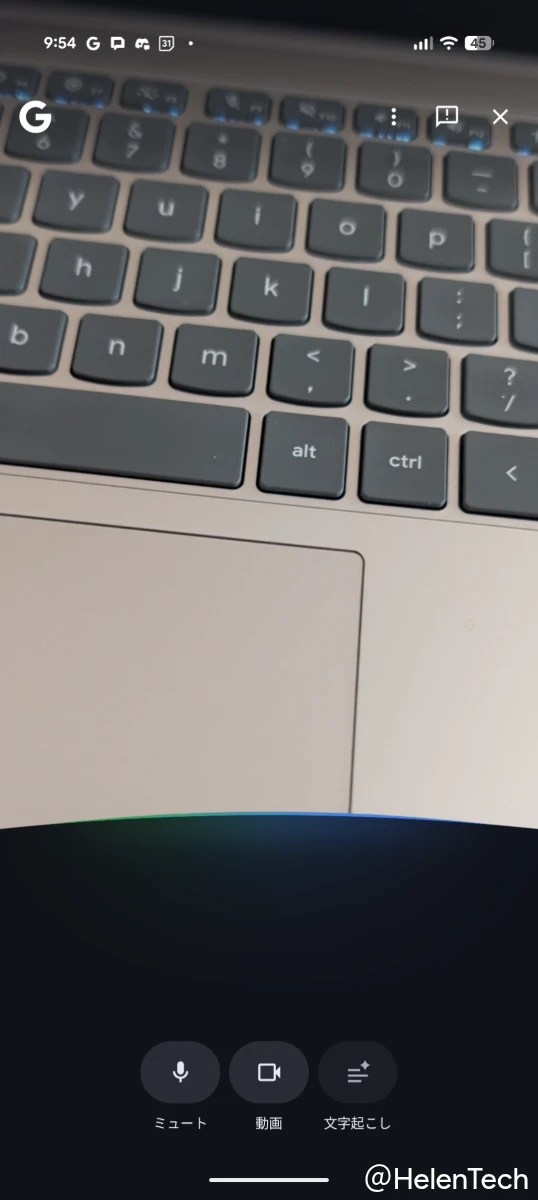

また、カメラを使った視覚情報の共有(マルチモーダル機能)を備えており、目の前にあるものを AI に見せながら質問することができます。たとえば、「この組み立て家具の設置方法を教えて」というような使い方が可能です。

Google レンズを使用している場合も、画面下部の「Live」オプションをタップするだけで、現実世界の風景や被写体について、リアルタイムで AI と会話しながら検索を続けることが可能です。

まとめ

今回の「検索 Live」のグローバル展開により、従来のテキスト入力による検索に加えて、スマートフォンのカメラで目の前の被写体を映しながら AI と音声で対話する検索方法が広く利用可能になります。

すでに順次展開が開始されており、対応するデバイスの Google アプリや Google レンズからアクセス可能です。直感的な新しい検索アプローチとして、日常の調べ物や問題解決への活用が期待されます。