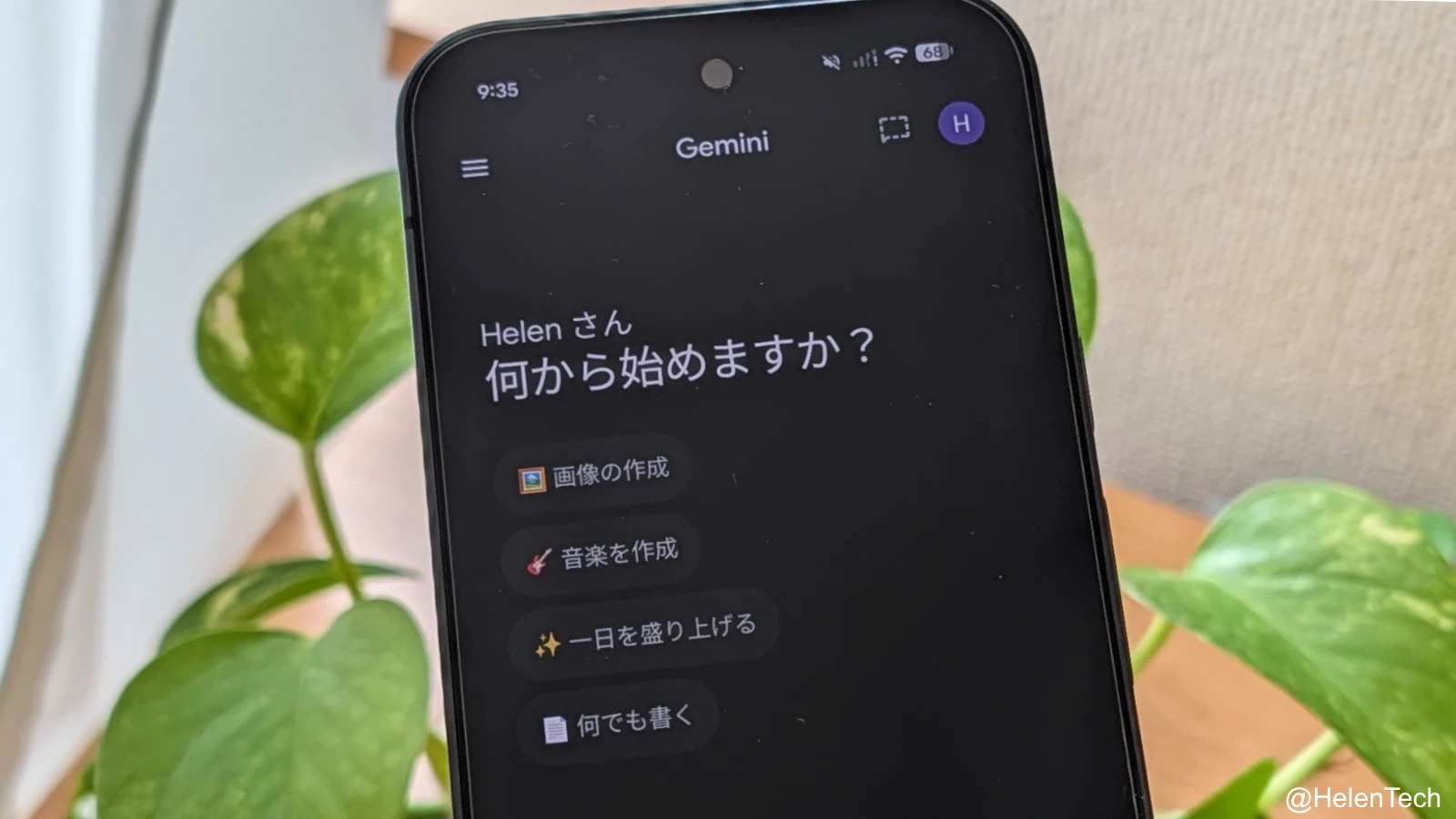

Google は 2026 年 5 月 12 日(現地時間)、Android 向けの新しい AI 機能となる「Gemini Intelligence」を発表しました。

この機能は今年夏に発表予定の新しい Google Pixel および Samsung Galaxy 向けに段階的に展開される予定で、年内にはスマートウォッチ、車、メガネ、ノートパソコン (Googlebook) への対応も予定されています。

Gemini Intelligence の主な機能

Gemini Intelligence は、プレミアムハードウェアと AI ソフトウェアを組み合わせ、日常のタスクを先回りして処理することを目的とした機能です。

Google はこの発表にあわせて、Android を「OS」ではなく「インテリジェンスシステム」へと位置づけ直すという方針を示しています。

アプリをまたいだマルチステップ自動操作

Gemini が複数のアプリにまたがるタスクを自動で処理できるようになり、フードデリバリーや配車アプリなどで利用可能です。

電源ボタンの長押しから Gemini を呼び出し、たとえば「いつもの食事を DoorDash で再注文して」と指示するだけでバックグラウンドで処理が進みます。

画像を使った操作にも対応し、たとえばホテルのロビーで旅行パンフレットの写真を撮り、「Expedia で 6 人向けのツアーを探して」と伝えると、Gemini がブラウザを操作してツアーを探します。

作業の進捗はリアルタイムで通知として確認でき、最終確認は必ずユーザーが行う仕組みになっています。

なお、Google は Galaxy S26 および Pixel 10 向けにフードデリバリー・配車アプリでの自動操作を数ヶ月かけて調整済みと説明しており、米国等で展開されている「画面の自動操作」機能の発展にあたります。

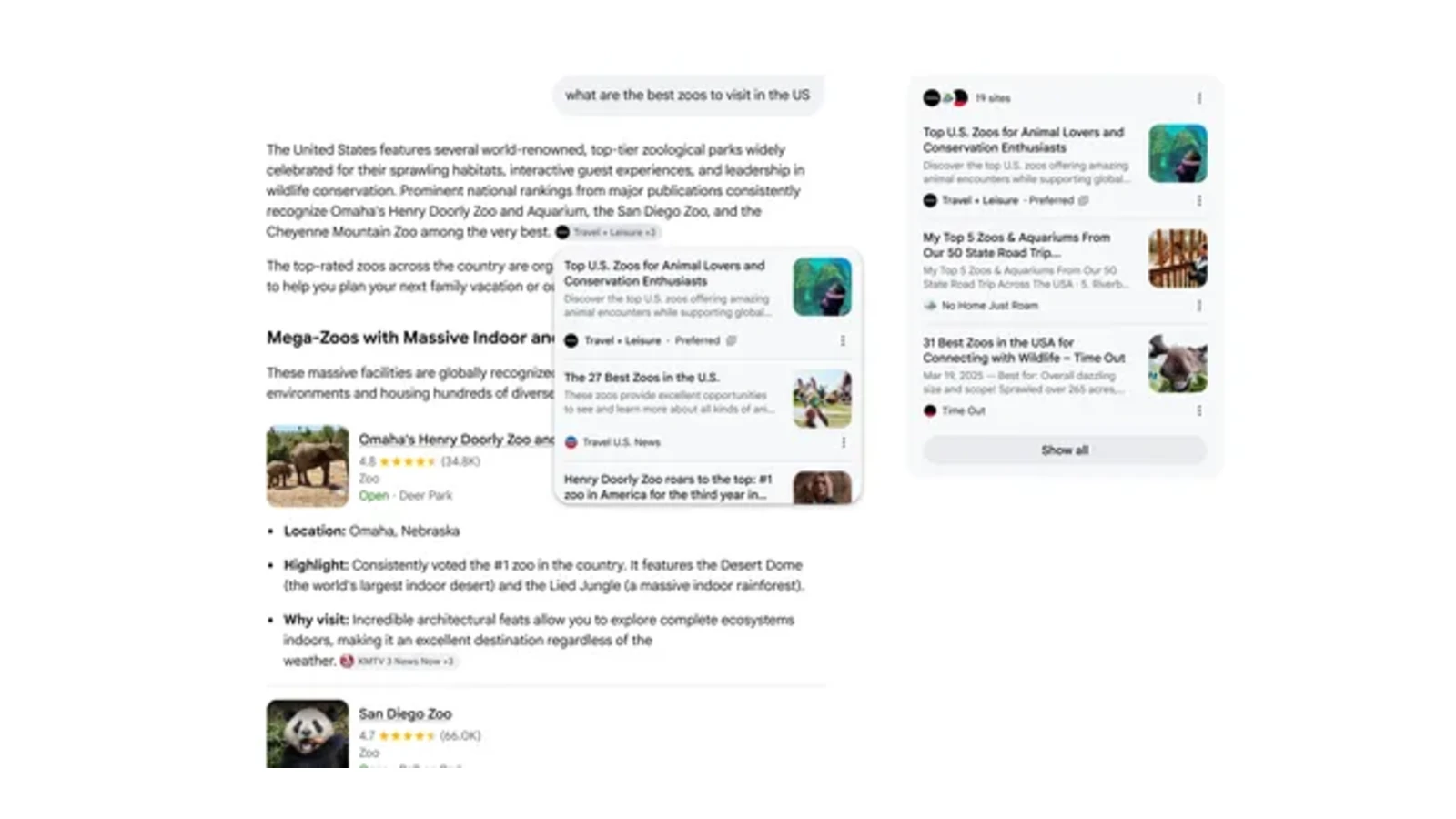

Chrome での自動ブラウズ

2026 年 6 月末から、Android デバイス向けに Chrome での閲覧をサポートする新機能として「自動ブラウズ」が追加されます。

Gemini in Chrome は、ウェブ上のコンテンツのリサーチ・要約・比較を補助するほか、予約やパーキングスポットの確保といった定型的なウェブ操作をユーザーに代わって処理します。

フォームの自動入力強化

「Autofill with Google」が強化され、Gemini のパーソナルインテリジェンスを活用して、Chrome を含む各アプリの複雑なフォームを自動入力できるようになります。

連携するアプリに保存された情報を参照して入力を補完します。パーソナルインテリジェンスとの連携はオプトイン制で、設定画面からいつでもオン・オフの切り替えが可能です。

Rambler:話し言葉を整えた文章に変換

Gboard に新機能「Rambler」が追加され、音声入力時の「えー」、「あー」、「あの」といったフィラーワードや繰り返しを自動で取り除き、要点をまとめた自然な文章に変換します。

Rambler を有効にすると、有効状態が画面上にされます。録音した音声はリアルタイム変換のみに使用され、保存・蓄積はされません。また、Gemini の多言語モデルを採用しており、英語とヒンディー語の混在など、複数言語が混ざった発話にも対応しています。

Create My Widget:自然言語でウィジェットを作成

ホーム画面のウィジェットを、自然言語の説明だけで生成できる新機能「Create My Widget」が追加され、Android スマートフォンだけでなく Wear OS ウォッチでも利用できます。

この機能は、たとえば「毎週高タンパクなミールプレップレシピを 3 つ提案して」と入力すると、対応するダッシュボードウィジェットが作成され、ホーム画面に追加・リサイズできます。

デザインのアップデート

Gemini Intelligence の展開にあわせ、Material 3 Expressive を発展させた新しいビジュアルシステムが導入されます。アニメーションに意味を持たせ、操作中の集中を妨げにくい設計になっています。

まとめ

Gemini Intelligence は、今年夏に発表される最新の Google Pixel シリーズおよび Samsung Galaxy シリーズが対象となります。

年内に Wear OS ウォッチ、Android Auto 対応の車、Android XR グラス、Chromebook / Googlebook(ノートパソコン)にも対応が拡大する予定です。