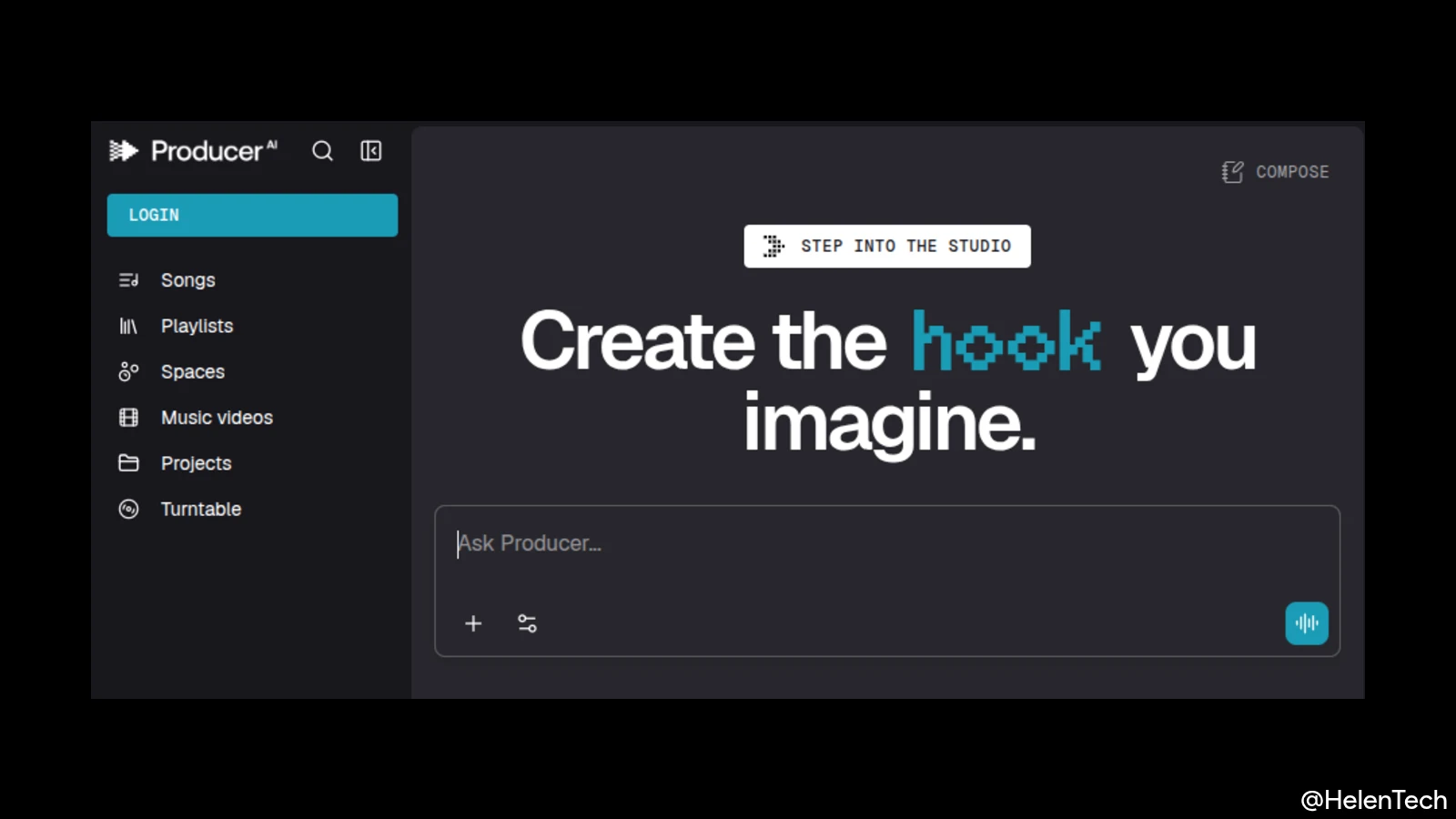

Google は 2026 年 2 月 24 日(現地時間)、生成 AI を使用して音楽を作成・編集できるプラットフォーム「ProducerAI」が、初期段階のプロジェクトを試せる Google Labs に加わったことを発表しました。

この「ProducerAI」はすでにグローバルで公開されており、無料プランを含めて提供されています。

記事執筆時点で筆者も試すことができており、日本語のプロンプトを含めて実行できることを確認しました。

プロンプトから本格的な楽曲を生成する ProducerAI

ProducerAI は、テキストの指示(プロンプト)から動的で本格的な楽曲を作り出すことができるクリエイティブツールです。

システムには、Google DeepMind が開発した Gemini をはじめ、Lyria 3、Veo、Nano Banana といった複数の最先端 AI モデルが活用されています。

ユーザーは「ローファイ(Lofi)のビートを作って」といったシンプルなリクエストから始め、歌詞の執筆やメロディの調整などを経て、オリジナルの楽曲を完成させることができます。

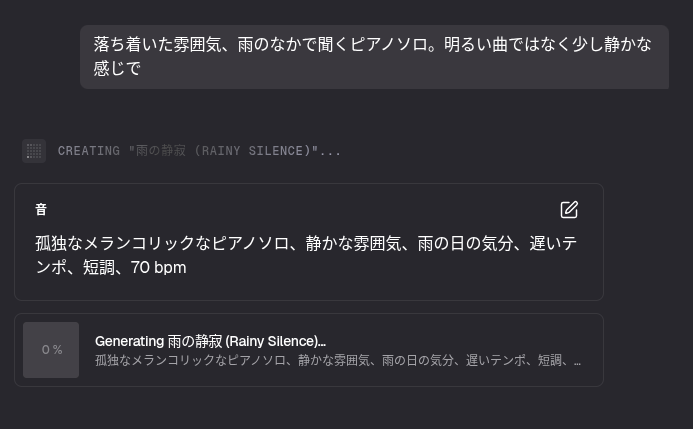

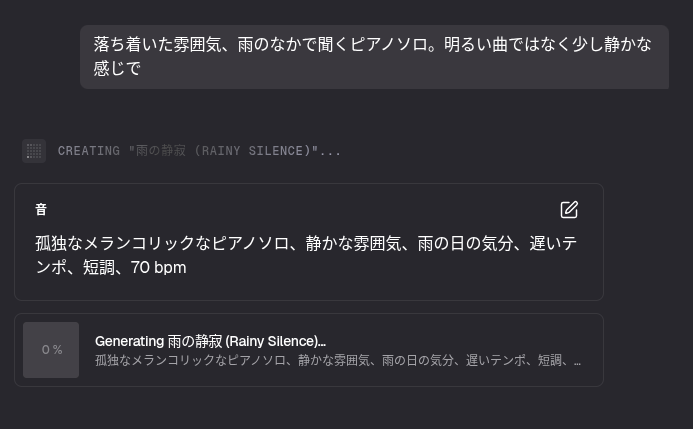

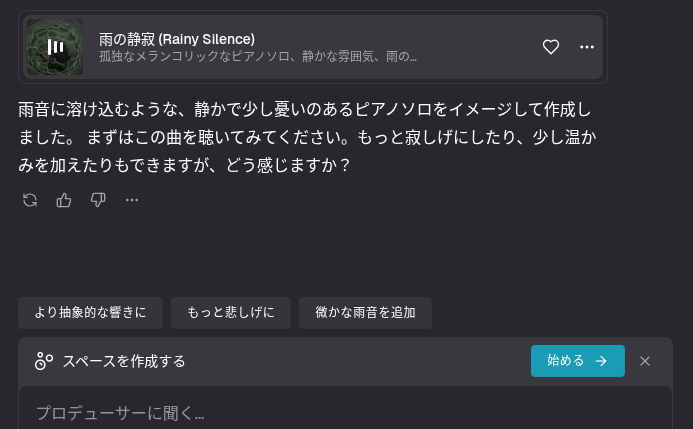

以下は実際に筆者が試してみた様子です。

このプロンプトで生成された曲は次のようなものです。

なお、ProducerAI で生成されたすべての楽曲には、AI 生成コンテンツであることを識別するための電子透かし「SynthID」が埋め込まれます。

クリエイター目線で開発された柔軟な編集機能

AI を使った音楽生成サービスはすでにいくつか存在していますが、The Chainsmokers など第一線で活躍するプロのミュージシャンが開発に協力しており、クリエイター目線で作られている点がこのツールの大きな強みです。

また、単に音楽を自動生成するだけでなく、リバーブの調整や低音の強調など、出力された楽曲に細かなアレンジを加えていくこともできます。

音楽制作の知識がないユーザーでも、直感的にオリジナルソングや動画用の BGM を作成でき、ProducerAI 側からの提案だけでも十分ですが、思い描いていることを言語化できる方がより良いものが作れると思います。

最新モデル Lyria 3 と拡張機能 Spaces による高い柔軟性

音楽的な品質を支えているのが、Google DeepMind の最新プロ向け音楽生成モデル「Lyria 3」のプレビュー版です。このモデルはリズムやアレンジといった音楽の構造を深く理解しており、テンポの変更や歌詞とボーカルのタイミング(タイムアライメント)の調整など、かなり詳細なコントロールを可能にしています。

さらに Google は、アーティストの表現力を拡張する機能として「Spaces(スペース)」という環境を提供します。これは、自然言語を使って「新しい楽器」や「エフェクト」そのものを作り出せる機能です。

シンプルなキーボードから、ノードベースの複雑なオーディオパッチング環境まで構築することができ、作成した環境(ミニアプリ)はユーザー間で共有したりリミックスしたりすることが可能です。

まとめ

これまで Google は、YouTube と連携してプロ向けの実験的ツール「Music AI Sandbox」を提供するなど、テクノロジーと音楽の融合を探求してきました。こうしたプロの現場からのフィードバックが、今回の Lyria 3 の開発や ProducerAI の実装に大きく貢献しています。

ProducerAI は、公式サイト(producer.ai)にてすでに利用可能となっており、無料プランと有料プランが用意されています。

Google Labs に加わったことで、今後は Google の他の AI ツールとの連携強化や、さらなる機能追加が進んでいくものと思われます。