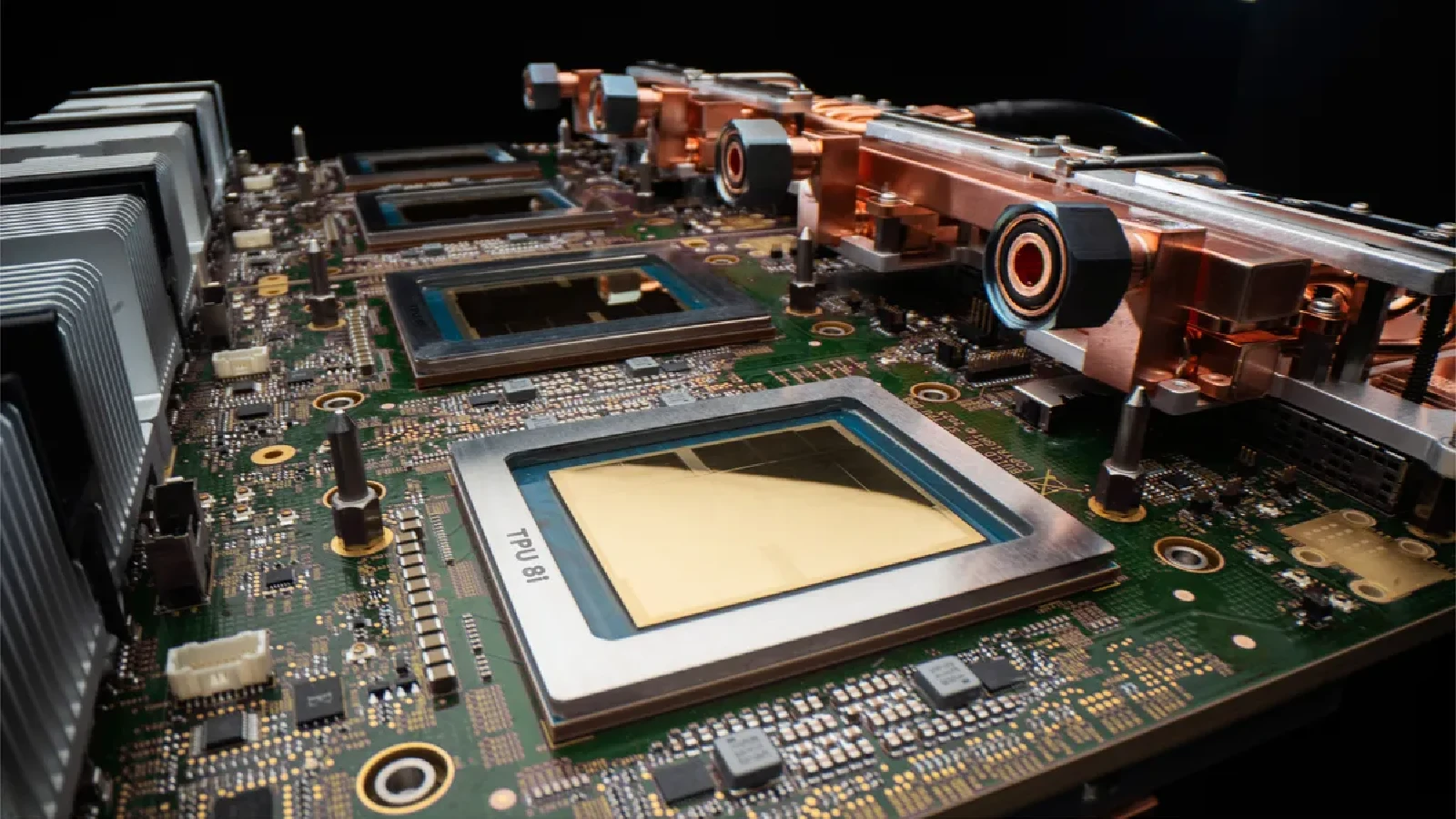

Google は 2026 年 4 月 22 日、Google Cloud Next 2026 にて、第 8 世代となるカスタム Tensor Processor Unit (TPU) である TPU 8t と TPU 8i を発表しました。

これらのチップは、AI エージェントの普及に伴う高度なワークロードの処理を目的としており、年内に一般提供が開始される予定です。

今回のアップデートにより、一般ユーザーが利用する Gemini の応答速度の向上や、複雑なタスクを自律的に処理する AI エージェント機能の本格的な普及につながることが期待されます。

用途別に最適化された 2 つのアーキテクチャ

今回発表された第 8 世代 TPU は、トレーニング用途に特化した TPU 8t と、推論およびエージェント開発に特化した TPU 8i の 2 つのアーキテクチャに分かれています。

AI モデルの大規模化にともない、開発と運用の各フェーズで求められる要件が異なることから、用途ごとに最適化されたチップを用いることで、全体的な電力効率とパフォーマンスの向上が図られています。

トレーニングに特化した TPU 8t

TPU 8t は、大規模な AI モデルの学習に必要な高い計算能力を備えており、前世代と比較して計算パフォーマンスが約 3 倍に向上しています。

大量のチップを連携させる新しいネットワーク構造を採用し、障害発生時にも自動で処理を継続する機能を備えることで、モデルの開発サイクルを数か月から数週間へと短縮することが可能になります。

推論およびエージェントに特化した TPU 8i

一方の TPU 8i は、複数のタスクを自律的に処理する AI エージェントの推論処理に最適化されています。

Google のカスタム Arm ベース CPU である Axion を採用し、メモリ容量や通信速度を強化することで、データ処理の遅延を大幅に抑えています。

前世代と比較してコストパフォーマンスが 80% 向上しており、同じコストで約 2 倍の推論リクエストを処理できます。これにより、より多くのユーザーに対して安定した AI サービスを展開できるようになります。

電力効率の向上とシステム全体の最適化

第 8 世代 TPU は、演算能力だけでなく電力効率も改善され、需要に基づいて電力の消費を動的に調整する機能を備えることで、前世代と比較して 1 ワットあたりのパフォーマンスが最大 2 倍に向上しています。

さらに、第 4 世代の液冷技術を採用し、空冷では維持できない高密度の処理を支えています。チップ単体だけでなく、データセンターのネットワークインフラや冷却システムを含めたフルスタックでの最適化が行われています。

まとめ

Google の第 8 世代 TPU 8t と TPU 8i は、用途別にアーキテクチャを分けることで、演算能力と電力効率の両立を目指しています。

AI の進化に伴って計算資源の需要が増加するなか、新しい TPU はクラウドインフラの安定化と環境負荷の低減に寄与することが期待されます。

これらのチップは、年内に Google AI Hypercomputer の一部として利用可能になる予定です。