Google は 2026 年 4 月 2 日(現地時間)、最新オープンモデルとなる Gemma 4 を発表し、提供を開始しました。

Gemini 3 と同じ研究と技術をベースに構築されており、スマートフォンなどのエッジデバイスで動作する軽量なモデルから、PC やワークステーション向けの大規模なモデルまで、用途に合わせた 4 つのサイズが展開されています。

また、今回のリリースでは Apache 2.0 ライセンスが採用され、開発者は自社のデータやインフラ、モデルを完全にコントロールしながら、これまで以上に自由な AI 開発が行えるようになりました。

用途に合わせて選べる 4 つのサイズ展開

Gemma 4 は、搭載するハードウェアのスペックや用途に合わせて最適なパフォーマンスを発揮できるよう、以下の 4 つのサイズが用意されています。

- Effective 2B (E2B): スマートフォンや IoT デバイス向け

- Effective 4B (E4B): スマートフォンや IoT デバイス向け

- 26B Mixture of Experts (MoE): PC やワークステーション向け(推論速度を重視)

- 31B Dense: PC やワークステーション向け(品質を重視)

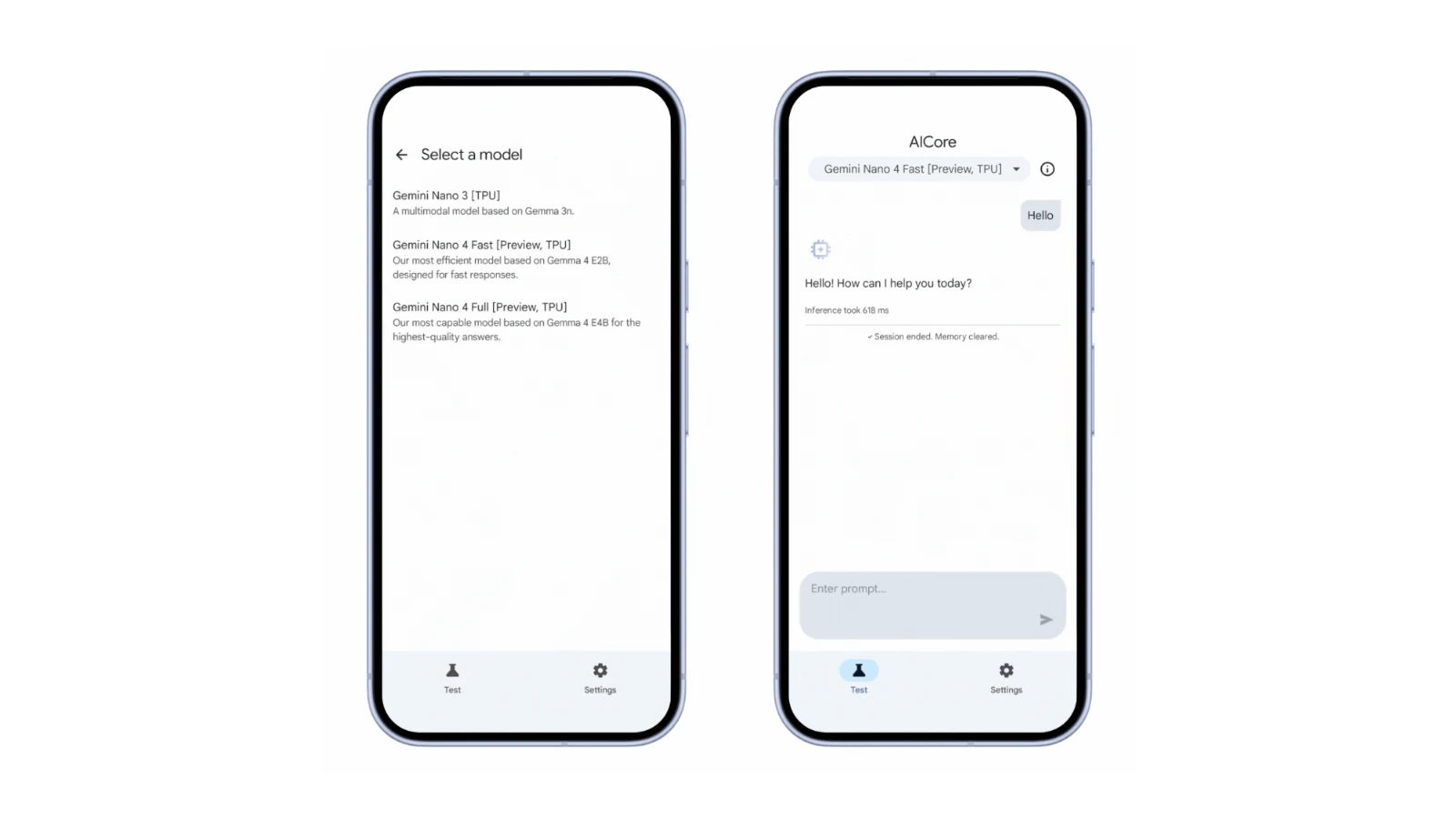

小規模な E2B および E4B モデルは、メモリやバッテリー消費を抑えつつ、オフライン環境でもほぼ遅延なく動作するように設計されています。Google の Pixel チームや Qualcomm、MediaTek といったモバイルハードウェア企業と連携して開発されており、今後の Pixel デバイスへの実装が期待されます。

すでに Android 開発者向けには AICore Developer Preview を通じてプロトタイプの作成が可能となっており、将来的な Gemini Nano 4 との互換性も確保されています。

一方、大規模な 26B および 31B モデルは、個人の PC 環境で最先端の推論能力を利用できるよう最適化されています。特に 31B モデルは、AI の性能を評価する Arena AI のテキストリーダーボードにおいて、オープンモデルとして世界第 3 位にランクインするなど、パラメータ数以上の高い処理能力を備えています。

より複雑な処理とマルチモーダルへの対応

Gemma 4 はチャット用途だけでなく、複雑な論理思考や自律的なワークフロー(Agentic workflows)の実行能力が向上しています。

全モデルがネイティブで動画や画像の処理に対応しており、高精度な OCR(光学文字認識)やグラフの読み取りが可能です。さらに、モバイル向けの E2B と E4B モデルは音声入力にも標準で対応しているため、デバイス上でのスムーズな音声認識が可能です。

また、一度に処理できる情報量(コンテキストウィンドウ)も拡大されました。エッジモデル(E2B / E4B)で 128K、大規模モデル(26B / 31B)では最大 256K に達し、長文のドキュメントや大量のコードを一度のプロンプトで処理できます。

開発環境と入手先

Gemma 4 はすでに公開されており、開発者は次のような環境で利用可能です。

- Google の環境: Google AI Studio(26B / 31B)、Google AI Edge Gallery(E2B / E4B)

- Android 開発: Android Studio の Agent Mode、ML Kit GenAI Prompt API

- モデルのダウンロード: Hugging Face、Kaggle、Ollama など

まとめ

Gemma 4 は、高度な処理能力とマルチモーダル対応を果たしながら、Apache 2.0 ライセンスのもとで公開された強力なオープンモデルです。

PC 向けの高性能モデルだけでなく、スマートフォン上で動作する E2B・E4B モデルが登場したことにより、今後のオンデバイス AI アプリの改善なども期待されます。