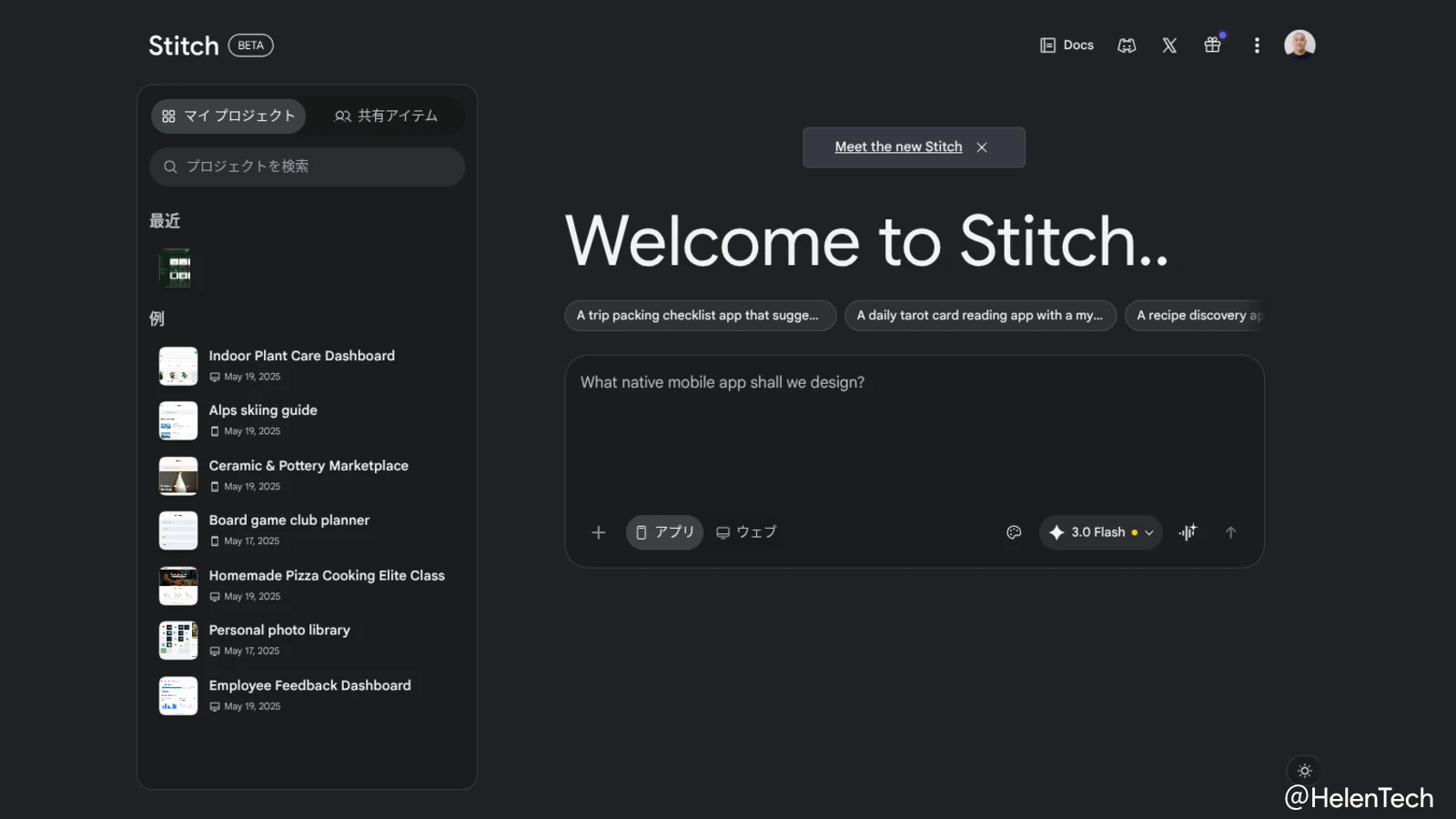

Google は 2026 年 3 月 18 日(現地時間)、自然言語からソフトウェアの UI をデザインできるツール Stitch のアップデートを発表し、 新しい無限キャンバスや音声によるデザイン指示、DESIGN.md への対応、Google AI Studio などの開発ツールとの連携を追加したことを明らかにしました。

これにより、アイデアの着想からプロトタイプの作成、コーディングまでのプロセスをさらにシームレスに実行できるようになります。

記事執筆時点で、筆者の日本語環境における Stitch で Gemini Live 風の音声指示や新しい UI の展開を確認することができました。

新しい AI ネイティブキャンバスと Agent manager

今回のアップデートで Stitch の UI が再設計され、アイデアの初期段階から動作するプロトタイプまでを拡張できる、 AI ネイティブな無限キャンバスが導入されました。画像やテキスト、コードなどをコンテキストとしてキャンバス上に直接配置することが可能です。

プロジェクト全体の進化を把握する新しいデザインエージェントも組み込まれ、複数のデザイン案を並行して試す際に進行状況を管理できる Agent manager が追加されており、アプリや Web サイトの構成を考える際、複数のパターンを同時に比較・整理しながら作業を進めることができます。

外部ツールと連携する DESIGN.md

デザインシステムの管理手法として DESIGN.md がサポートされました。任意の URL からデザインシステムを抽出できるほか、エージェント向けのマークダウンファイル (DESIGN.md) を利用して、他のデザインツールやコーディングツールとデザインルールのインポートおよびエクスポートが可能になります。

新しいプロジェクトを立ち上げるたびにデザインルールを作り直す手間が省けるため、チーム内でのデザインの統一や、他の環境への移行をスムーズに行うことができます。

音声による Vibe design と即時のプロトタイプ作成

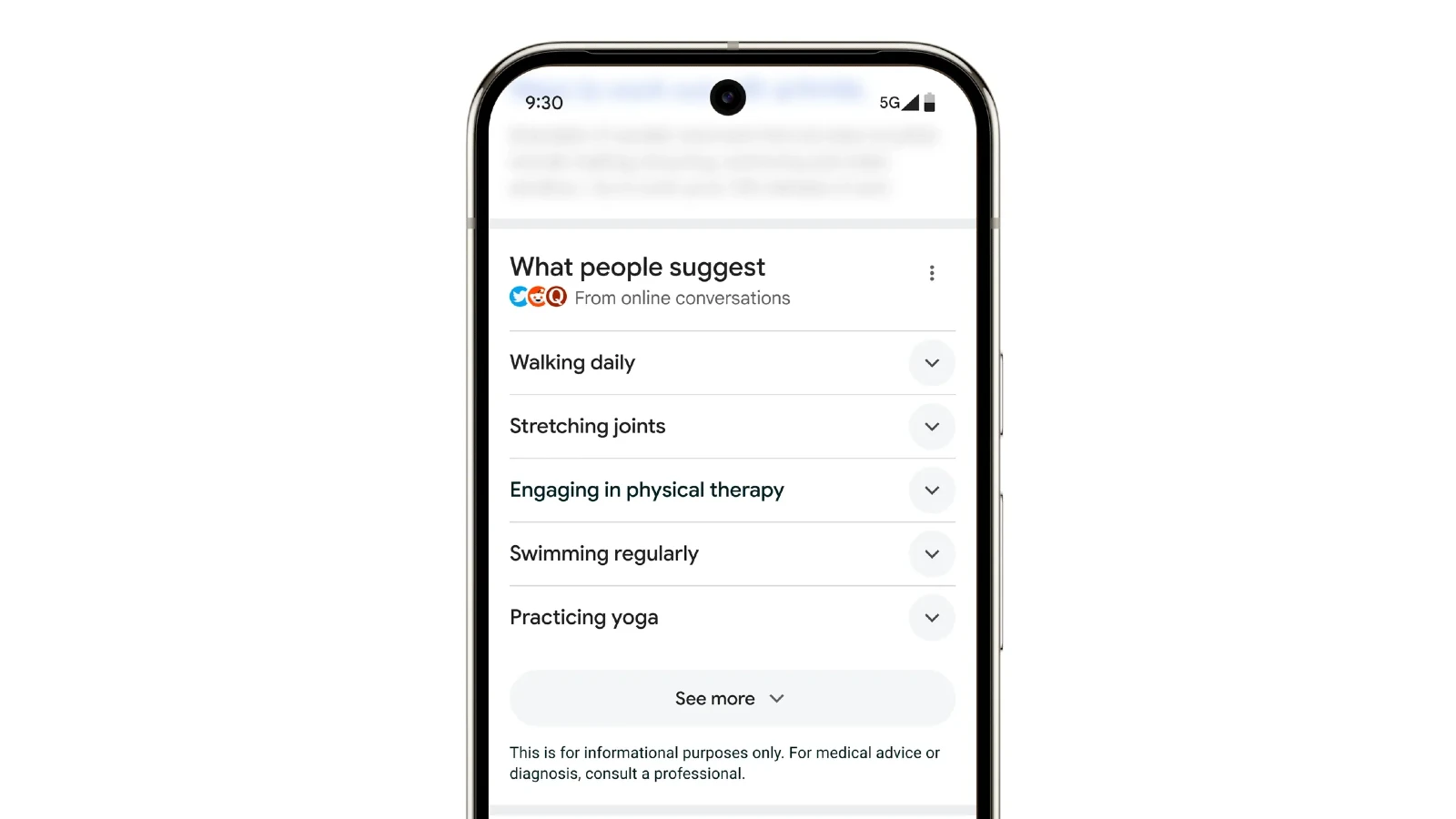

直感的な Vibe design と Gemini Live に似た音声機能が導入され、キャンバスに向かって直接話しかけることができるようになりました。

AI エージェントがリアルタイムでデザインの批評を行ったり、「メニューの選択肢を 3 つ出して」「この画面を違うカラーパレットで見せて」といった口頭での指示に反応します。

静的なデザインをインタラクティブなプロトタイプに変換する機能も強化されており、画面同士をつなぎ合わせて Play をクリックするだけで、実際のアプリのような操作フローをプレビューできます。

クリックに応じた論理的な次の画面を AI が自動生成するため、専門的な知識がないユーザーでもアイデアを形にして挙動を検証できます。

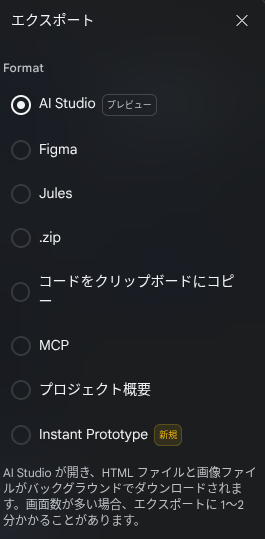

Google AI Studio など開発ツールへの出力

デザインからコードへの移行作業も改善されており、リリースされた Stitch MCP サーバーと SDK を利用し、スキルやツールを通じて Stitch の機能を拡張できるほか、作成したデザインを Google AI Studio や Antigravity といった開発者向けツールへ直接エクスポートすることが可能です。

デザインと開発の分断という課題に対して、 AI を介することでデザインからコーディングまでを一貫して行える環境が整いました。

まとめ

新しくなった Stitch は、デザイナーが複数のバリエーションを試す場合や、初心者がソフトウェアのアイデアを形にする場合において、アイデアから実現までの時間を短縮するツールです。自然言語や音声で UI を構築し、プロトタイプからコード出力までをシームレスに行うことができます。

Stitch はすでに日本語環境でも利用することができ、今回発表されたほとんどの機能も筆者が確認した限りでは、機能しているようです。