Google は 2026 年 4 月 22 日(現地時間)、テキスト、画像、動画、音声、ドキュメントを単一の埋め込みスペースで処理できるネイティブマルチモーダル対応モデル Gemini Embedding 2 の一般提供を開始したことを発表しました。

これまでのパブリックプレビュー期間を経て安定性と最適化が図られ、現在は Gemini API および Vertex AI を通じて本番環境での利用が可能になっています。

テキストや画像、音声をまとめて理解するマルチモーダル機能

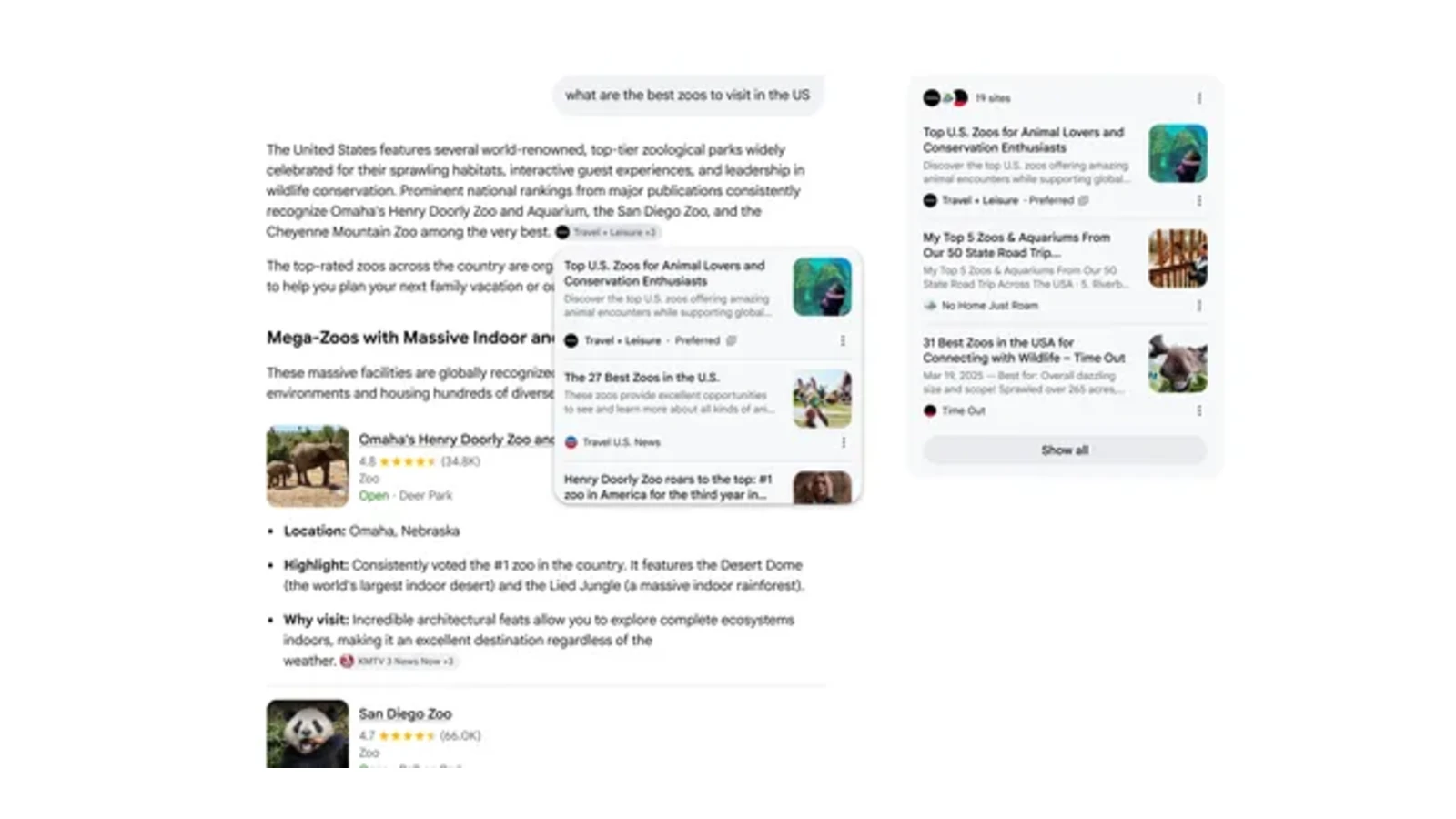

Gemini Embedding 2 は、多様なデータ形式を 1 回のリクエストで組み合わせて処理できることが最大の特長です。

プレビュー期間中には、この機能を活かして電子商取引向けの高度な検索エンジンや、効率的な動画分析ツールなど、優れたプロトタイプが多数開発されました。

テキストと画像を同時に読み込ませることで、データ間の複雑な関係性を AI がより正確に理解し、高精度な検索や分類が可能になります。

各データ形式における処理の上限は以下のとおりです。

- テキスト: 最大 8192 トークン

- 画像: 1 回のリクエストにつき最大6枚(PNG および JPEG 形式に対応)

- 動画: 最大 120 秒(MP4 および MOV 形式に対応)

- 音声: 事前にテキスト化(文字起こし)することなく、直接読み込んで処理が可能

- ドキュメント: 最大 6 ページの PDF ファイルを直接処理

音声をテキスト化する手間が省ける点や、画像とテキストを組み合わせた複雑な検索システムを構築できる点は、開発者にとって非常に扱いやすい設計になっています。

将来的に、Google Workspace 上での社内データ検索(RAG)や、独自チャットボットの精度向上なども期待できます。

コストと精度のバランスを調整できる柔軟な設計

Gemini Embedding 2 は「マトリョーシカ表現学習(MRL)」と呼ばれる技術を採用しており。出力されるデータのサイズ(次元数)を柔軟に縮小できるため、アプリのパフォーマンスとストレージコストのバランスを取りやすくなっています。

標準の次元数は 3072 となっており、用途に合わせて3072、1536、768のいずれかを使用することで、最も高い品質が得られると推奨されています。

本番環境への展開と統合

今回の一般提供により、Gemini Embedding 2 はプレビュー版からさらに安定性が向上し、プロジェクトを本番環境へ移行するための最適化が施されました。

既存のテキスト、画像、動画の各タスクにおいて主要なモデルを上回るパフォーマンスを発揮し、高度な音声処理能力も備えています。

現在、Gemini API と Vertex AI からアクセスできるほか、LangChain や LlamaIndex、Vector Search といった主要な AI 開発ツールやデータベースにも対応しています。

企業が社内の膨大なデータから必要な情報を引き出したり、複雑な文書やメディアファイルを横断的に分析したりするアプリケーションにおいて、Gemini Embedding 2 はより強力な選択肢になります。