Google は 2026 年 2 月 25 日(現地時間)、Android アプリが AI エージェントと直接連携するための新たな開発者向け機能「AppFunctions」と「Intelligent UI automation」を発表しました。

これは Pixel 10 シリーズや Galaxy S26 シリーズ向けに先行展開される Gemini によるアプリの自動操作機能の裏側を支える仕組みであり、次期 OS の Android 17 に向けて、ユーザーがアプリを開かなくても AI に任せるだけで簡単に操作できるようになることを目指すものです。

アプリの機能を AI に直接公開する「AppFunctions」

今回発表された「AppFunctions」は、Android アプリのデータや機能を AI エージェントから直接呼び出せるようにするプラットフォーム API および Jetpack ライブラリです。処理はサーバーではなくデバイス上でローカルに実行されるため、プライバシーやセキュリティが保護された状態で機能します。

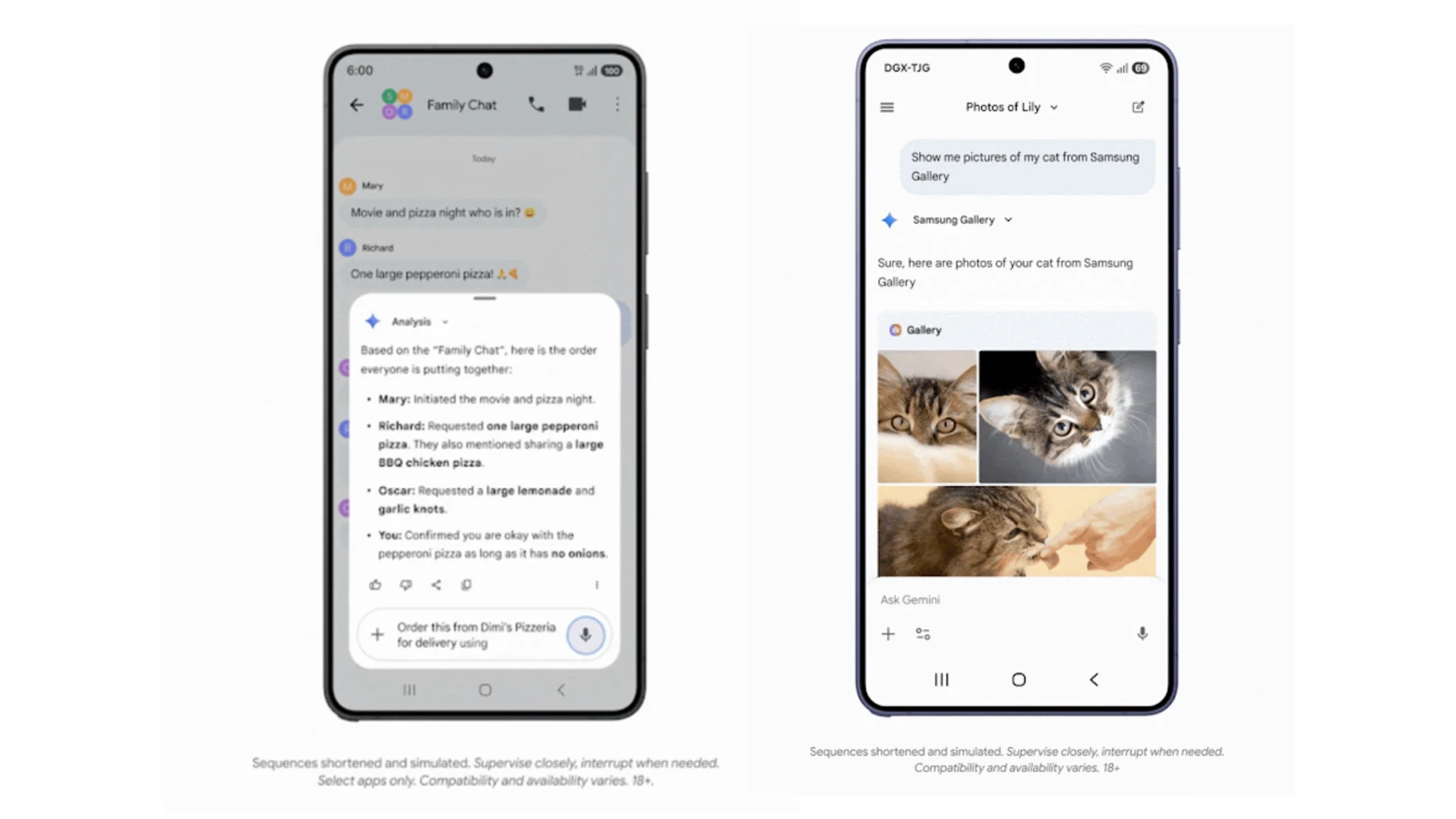

この例として、Galaxy S26 シリーズでの Samsung Gallery と Gemini の統合が挙げられています。

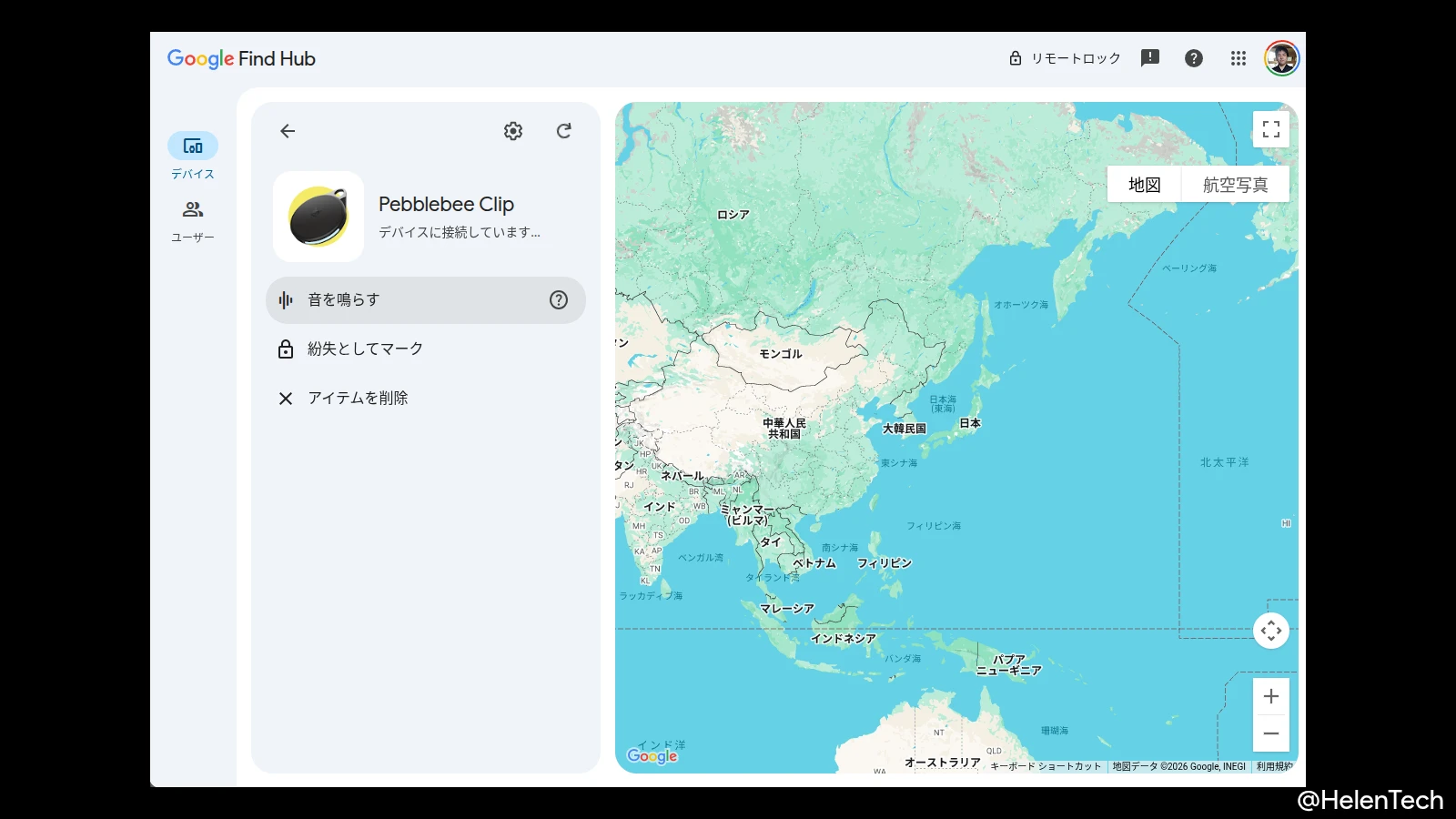

ユーザーが「Samsung Gallery から猫の写真を見せて」と音声やテキストで指示すると、Gemini が AppFunctions を通じてギャラリーの検索機能を実行し、Gemini の画面上にそのまま写真を表示します。

さらに、検索した写真をそのままメッセージで送信するといった連携もスムーズに行えます。これにより、わざわざアプリを探して開く手間を省けるようになります。

この機能は今後、OneUI 8.5 以降を搭載する Samsung デバイスにも拡大される予定で、すでにカレンダーやタスク管理などの分野で複数メーカーのデバイスをまたいだテストが行われています。

開発者の対応不要で AI が操作する「Intelligent UI automation」

すべてのアプリがすぐに AppFunctions を導入できるわけではないため、Google は開発者のコード修正(ゼロコード)なしで AI がアプリを自動操作できるフレームワーク「Intelligent UI automation」もプレビューとして公開しました。

先の記事でお伝えした、Gemini に「いつもの食事を再注文して」と頼むだけで裏側で処理が進む機能は、この UI automation を活用したものです。現在米国と韓国において、Galaxy S26 シリーズや一部の Pixel 10 デバイス向けに、フードデリバリーや配車アプリなどの特定カテゴリでテストされています。

開発者の負担を増やすことなく AI 連携を実現できるアプローチをとっているため、アプリ側の本格的な対応を待たずに多くのサービスで AI の恩恵を受けられるようになるのは、ユーザーにとっても大きなメリットです。

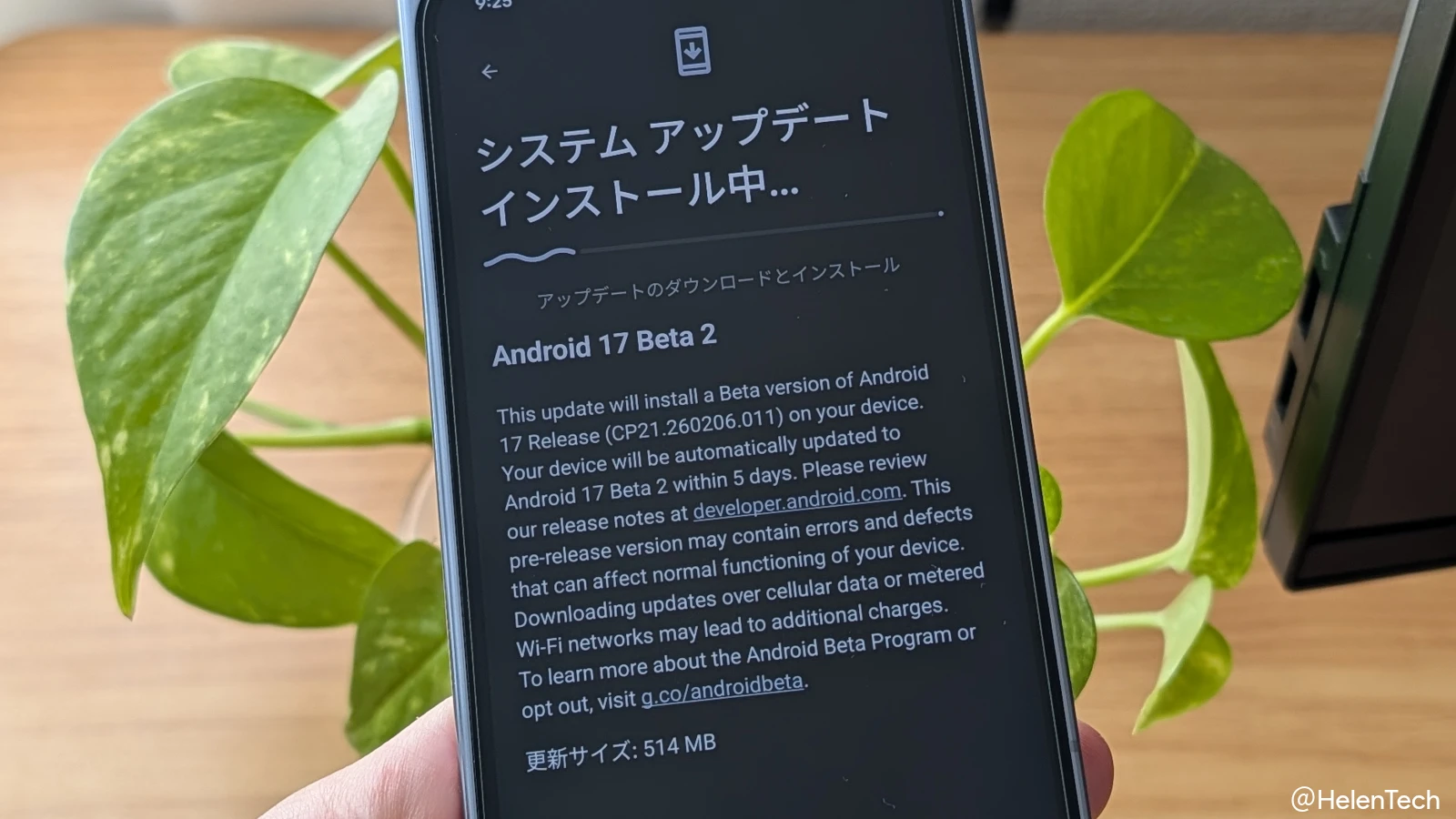

Android 17 での本格展開が予定

Google は、これらの機能を次期 OS である Android 17 でさらに多くのユーザーや開発者、デバイスメーカーへ展開していく計画です。

現在は一部の開発者向けに提供されており、今年後半には AppFunctions や UI automation のより詳細な仕様が公開される予定です。

開発者向けの環境整備が進むことで、日本国内の Pixel 10 ユーザーもこれらの機能を利用できるようになることが期待されます。