Google は 2025 年 12 月 17 日(現地時間)、スピードと高度な知能を低コストで両立させた最新 AI モデル「Gemini 3 Flash」を発表しました。

これまで AI モデルの選択において、ユーザーは「高い知能を持つが動作が重く高価なモデル」か「高速で安価だが知能が限定的なモデル」かの二択を迫られてきましたが、Gemini 3 Flash はこの妥協を終わらせるモデルとして位置付けられています。

日本でもすでに展開されており、Gemini API および Vertex AI を通じて開発者向けに提供され、個人のユーザー(Google Workspace 含む)の Gemini アプリにも展開が開始しています。

Gemini 2.5 Pro を大きく上回る性能と効率性

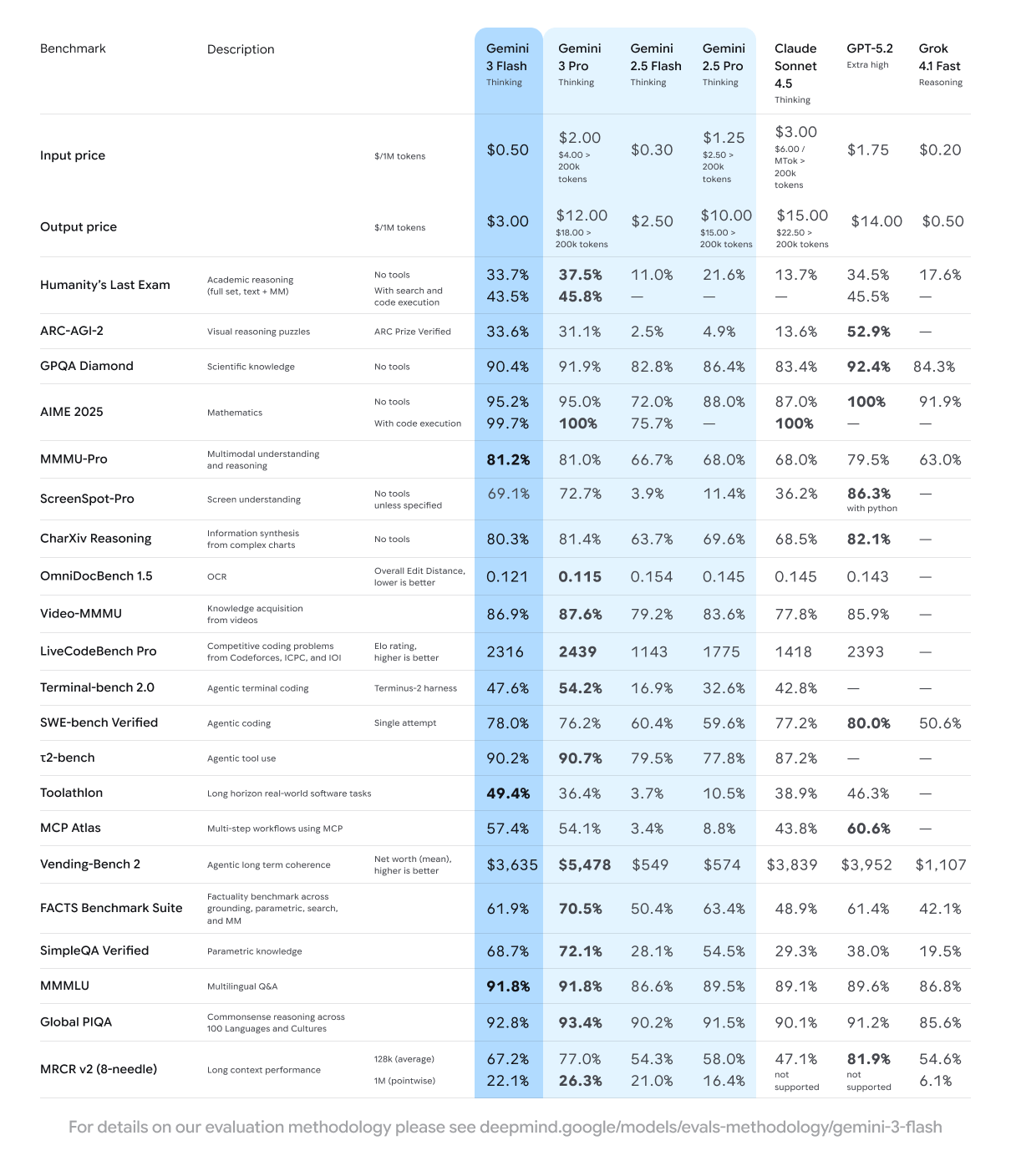

Gemini 3 Flash の最大の特長は、前世代の上位モデルである Gemini 2.5 Pro を多くのベンチマークで上回る性能を持ちながら、圧倒的な処理速度を実現している点にあるとしています。

専門的な知識や推論能力を測定する「GPQA Diamond」では 90.4% という高いスコアを記録しており、博士レベルの難解な質問にも対応できる知能を備えています。

その上、コスト面では Gemini 3 Pro の 4 分の 1 以下に抑えられており、API を利用する開発者にとっても極めて導入しやすい設計となっています。

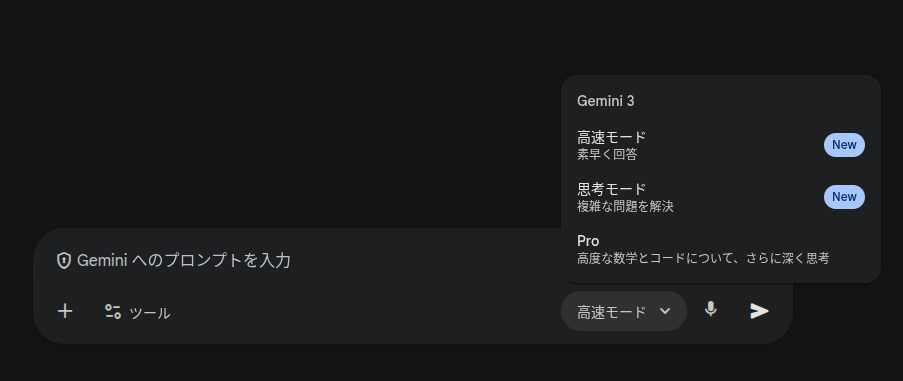

「高速モード」と「思考モード」で使い分けがより明確に

一般ユーザー向けの Gemini アプリにおいても、Gemini 3 Flash の導入に合わせて、従来 2 つの選択肢だったモードが、以下の 3 つになります。

- 高速モード (Fast):日常的な質問や短いテキスト生成など、スピードを優先する場面に最適

- 思考モード (Thinking):複雑な推論が必要な問題や、論理的なステップを要するタスクに対応

- Pro:引き続きモデルピッカーから選択可能で、高度な数学やプログラミングに特化

このうち、「高速モード」と「思考モード」は Gemini 3 Flash が利用され、「Pro」は Gemini 3 Pro が利用されます。

筆者も少し試してみたところ、2.5 Pro では若干物足りなかった部分が 3 Flash でもフォローされている印象でした。これまで上位モデルでしか実現できなかった高度な推論が、このレスポンスの速さで利用できるようになった点はメリットです。

高度なマルチモーダル機能と開発現場での活用

Gemini 3 Flashは、画像や動画、音声といった複数の情報を同時に扱うマルチモーダル能力も大幅に強化されています。

特に視覚的な推論能力が向上しており、画像内の物体をカウントしたり、動画の内容を詳細に分析して編集の指示を出したりといった「コード実行」を伴う高度な処理が可能です。

すでに多くの企業がこの新モデルを採用しており、例えばコーディング支援プラットフォームの「Google Antigravity」では、開発者の思考スピードに合わせてリアルタイムにコードを提案するエージェントとして活用されています。

また、ゲーム開発の分野では、プレイヤーの行動に合わせてリアルタイムで賢いキャラクターや世界観を生成するなど、低遅延・高知能という特性を活かした新しい使い方が広がっています。

まとめ

Gemini 3 Flash が登場したことにより、2.5 Pro よりも高性能かつ低コストのモデルを選択できるようになりました。

ただ、実際に使ってみた印象では、単純な内容の壁打ち相手なら「高速モード」でも十分(これも従来より賢い)ですが、ビジネスや研究で深く考える必要がある場合には、やはり「思考モード」が基本となります。

すでに日本でも利用可能になっていますので、Gemini をお使いの方はぜひ試してみてください。

出典: Google Blog